之前我们介绍过LangChain通过Runnable和LCEL来实现各个组件的快捷拼装,整个过程就像拼积木一样。

今天我们深入剖析Runnable接口的底层实现逻辑。

往期文章推荐:

- 16.Docker实战:5分钟搞定MySQL容器化部署与最佳实践

- 15.Ollama模板全解析:从基础语法到高级应用实战

- 14.Ollama完全指南:从零开始玩转本地大模型部署

- 13.django中如何解析content-type=application/json的请求

- 12.实测DeepSeek分词机制:你的输入如何变成计费Token?

- 11.英语分词进化论:BPE相关论文汇总

- 10.硬核实战 | 3分钟Docker部署ClickHouse列存数据库

- 9.技术深解 | DeepSeek-R1-0528训练参数全透视:163K上下文与MoE高效架构的基石

- 8.DeepSeek最新升级实测:推理能力翻倍,但离世界顶尖还有多远?

- 7.血泪教训!Redis默认配置竟会导致数据丢失?Docker生产部署指南

- 6.Function Call:大模型如何突破自身局限“使用工具“

- 5.DeepSeek动手实践:创建一个自动连点器

- 4.告别无效提示!使用少样本学习让AI秒懂你的需求

- 3.解密PromptTemplate:为什么说它是AI时代的Jinja模板?

- 2.LangChain Core架构解析:模块化设计与LCEL原语实现原理

- 1.拒绝重复造轮子!LangChain如何简化LLM应用开发

LangChain Runnable

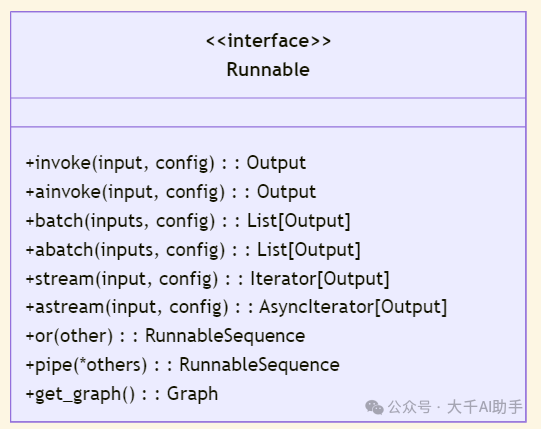

我们知道LangChain的Runnable接口是LangChain设计的基石, 实现了与所有组件的标准化交互, 代表一个可以被调用的、可并行化的、可流处理的、可变换的、可组合的工作单元。

Runnable抽象

Runnable关键接口

LangChain中所有runnable都得继承Runnable并实现核心的invoke方法,同时还会继承其他运算符(batch、stream、async等)的默认实现。

关键执行方法

抛开事实不谈

-

•

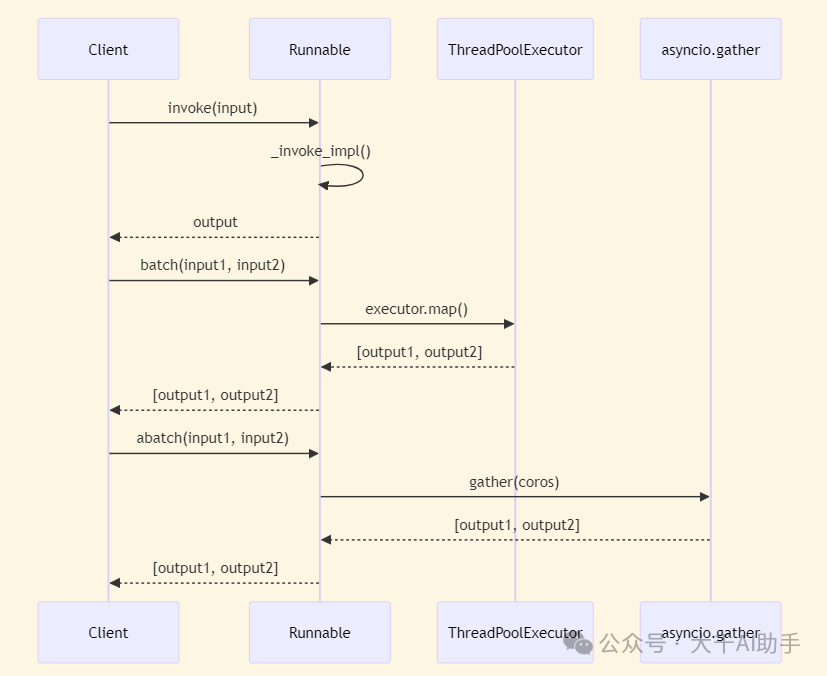

invoke就是单入单出的同步变换,就比如你突发奇想😲,每次拿一个生水饺来煮,煮完产生一个熟水饺。 -

•

batch就是多入多出的批量同步变换,就比如你家有6口锅😁,并且还可以一起来煮水饺,然后你每次拿6个生水饺来煮,一锅一个,煮完产生6个熟水饺。LangChain是运行在计算机上的,所以不用锅,底层是通过线程池实现的并行执行。 -

•

ainvoke类似invoke,但是是异步的,也就是你把水饺放好就去忙其他的去了,不在火旁看着。底层通过asyncio.gather实现异步。 -

•

abatch类似batch,但是也是异步的,也是不在火旁看着。底层通过asyncio.gather实现异步。

执行流程时序图:

流式处理

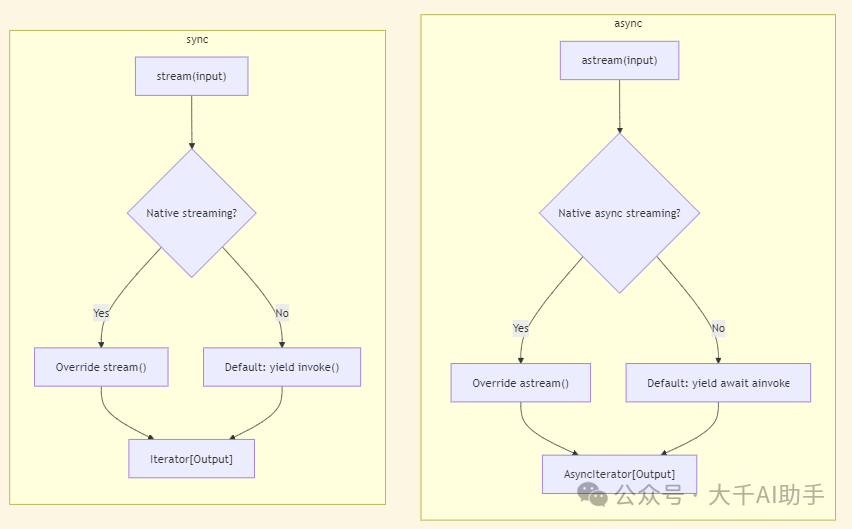

这里的流式处理是指按token生成进度逐步返回数据,而非等待完整响应才返回给客户端数据。

这种机制通过减少用户感知延迟,显著提升交互体验。

流式处理适用于实时交互场景(如聊天机器人)。

流式执行的逻辑

总结

LangChain的Runnable接口通过标准化设计:

-

1. 统一各类AI组件的调用范式

-

2. 提供同步/异步、单次/批量、流式/非流式等完整调用模式

-

3. 支持通过LCEL实现声明式组件组合

这种设计使开发者能像拼装积木一样构建AI应用,大幅提升开发效率。

本文由「大千AI助手」原创发布,专注用真话讲AI,回归技术本质。拒绝神话或妖魔化。搜索「大千AI助手」关注我,一起撕掉过度包装,学习真实的AI技术!

方法详解)

: 发布订阅模式)