### **构建完整的智能环:具身智能系统的层级化架构探析**

#### **引言:迈向与现实交互的智能**

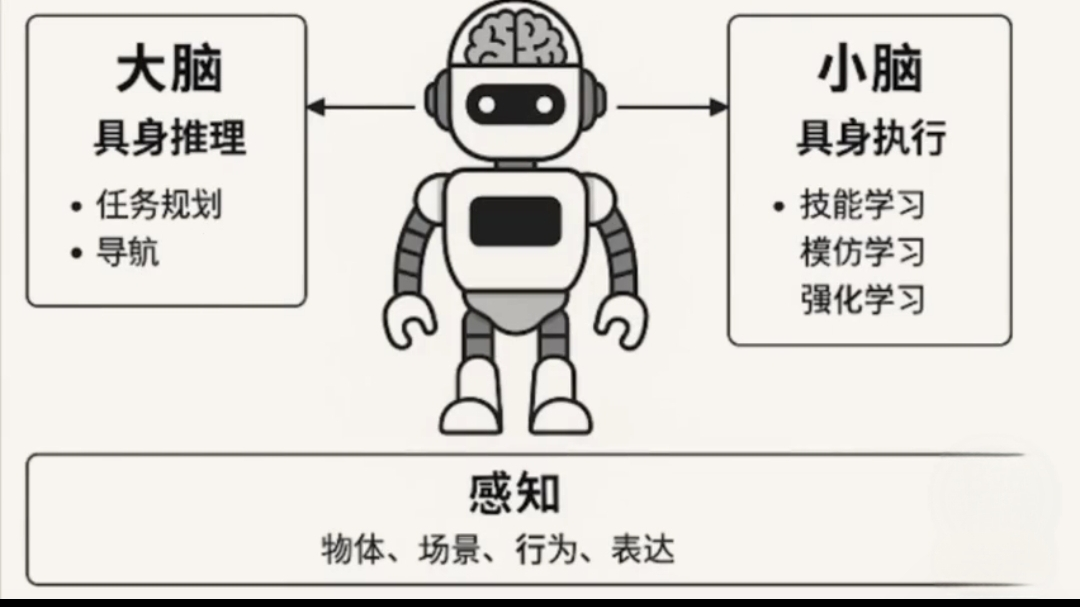

人工智能的发展正经历一场从“虚拟”走向“现实”的范式迁移。具身智能,作为这一浪潮的核心,强调智能体必须拥有“身体”,并通过与物理世界的实时交互来感知、学习和行动。这并非单一技术的突破,而是一个融合感知、认知、决策与执行于一体的复杂系统工程。本文旨在通过一个层级化的架构模型,解析具身智能如何将多方软硬件技术融为一体,形成一个闭合的、不断进化的智能环。

#### **第一层:感知边界——传感器的硬件极限**

一切智能的起点是感知。**传感器**(如摄像头、LiDAR、麦克风、陀螺仪、触觉传感器)构成了智能体的感官末梢,是其与物理世界连接的底层硬件。然而,这一层也首先定义了智能体的**绝对边界**。传感器的分辨率、帧率、视野、信噪比和测量范围,从根本上限制了智能体所能“看到”和“听到”的世界细节与广度。一个只能感知RGB图像的机器人,无法理解世界的三维几何;一个麦克风阵列有限的设备,难以在嘈杂环境中进行声源定位。因此,硬件的能力是智能体认知天花板的第一个决定性因素。

#### **第二层:数据桥梁——采集器的连通使命**

原始传感信号是混乱且高冗余的。**采集器**(通常指嵌入式系统上的数据采集模块与驱动)扮演了“神经系统”的角色。它的核心使命是**连通**:负责硬件控制、信号调理、模数转换、时间同步与数据预处理,将来自不同模态、不同物理单位的原始数据,转化为标准化的、可供上层处理的数据流。采集器的效率和稳定性,决定了感知数据的质量和时效性,是确保后续认知环节得以顺利进行的基石。

#### **第三层:理解世界——特征提取与模式识别**

获得了干净的数据流后,智能体需要从中提炼出有意义的信息。这一过程依赖于**特征提取与模式识别**。通过深度神经网络等算法,智能体能够:

* **从像素中**提取出边缘、纹理、物体类别和实例。

* **从点云中**分割出地面、障碍物和可行区域。

* **从声波中**识别出语音指令、异常声音或声源方位。

* **从力学数据中**识别出抓取滑移、碰撞触觉或行走步态。

至此,无序的数据被转化为了结构化的、富含语义的**环境特征**,为更高层的认知提供了原料。

#### **第四层:内心推演——构建可操作与可预测的动态世界模型**

这是具身智能区别于传统AI的**核心认知飞跃**。智能体不再仅仅对当前输入做出反应,而是基于已提取的特征,在其内部构建一个**可操作、可预测的动态世界模型**。这个“内心推演”的过程包含几个精妙的子环节:

1. **环境感知:** 这是构建世界模型的基础。它并非简单的数据接收,而是对第三层提取的特征进行**融合与语义理解**,形成一个关于外部环境的、统一的、具有语义标注的即时快照。它回答了“当前环境中有哪些东西?它们在哪里?状态如何?”

2. **自我映射:** 智能体必须清晰地知道“我”在这个环境中的位置。**自我映射**就是通过在环境感知中定位自身,建立“自我”与“环境”的空间和状态关系。它明确了自身的形态、坐标、姿态、速度等信息,是一切以自我为中心进行推理和规划的前提。

3. **非我识别:** 这是区分主体与客体的关键认知功能。**非我识别**将对环境中所有感知到的物体进行划分,识别出哪些是**智能体自身**,哪些是**外部客体**(如障碍物、工具),以及哪些是**其他智能体**。这一过程是理解互动、预测他人行为、进行社交协作的基础。

4. **规则模拟:** 世界不仅是静态的,更是遵循物理法则和社会规则的。**规则模拟**是智能体内化的关于世界如何运作的“常识”。它让智能体能够预测:松开的物体会下落(重力),撞上障碍物会停止(碰撞),靠近火源会灼伤(因果关系)。这些内化的规则是其进行安全、有效推演的约束条件。

5. **小世界建模:** 在上述环节的基础上,智能体最终能构建出一个缩略的、但富含语义和规则的**内部小世界模型**。这个模型是对外部现实的高度抽象和数字化表达,是智能体进行所有“思考”的沙盘。

6. **事态预测:** 这是认知从“现在”迈向“未来”的关键一步。基于建立的小世界模型和内化的规则,智能体能够进行**多模态、多时间线的预测**。它可以推演:

* **物理预测:** “如果我以当前速度继续前进,5秒后将会撞上那面墙。”

* **意图预测:** “那个移动中的行人(非我识别),依据其轨迹和交通规则(规则模拟),很可能在路口右转。”

* **交互预测:** “如果我伸手去拿那个杯子,我的机械臂是否会碰到中间的障碍物?”

事态预测赋予了智能体前瞻性的能力,使其能够预见潜在的风险和机会,从而做出更优的决策。

7. **动态注意力:** 这是智能体在信息爆炸的世界中管理稀缺算力资源的核心机制。**动态注意力**机制像一个灵活的“认知探照灯”,其照射焦点由**当前任务和事态预测的结果共同驱动**。

* 当预测到潜在碰撞时,注意力会**聚焦**于障碍物和路径规划。

* 当听到语音指令时,注意力会**聚焦**于声源和说话者的口型。

* 当预测到另一个智能体有交互意图时,注意力会**聚焦**于对方的行为线索。

它使智能体能够主动地、有选择地**忽略**无关信息,**放大**关键信息,从而实现高效、节能的认知 processing。

至此,智能体完成了从“看到”到“理解”,再到“能够推演未来”并“主动聚焦”的完整认知闭环。

#### **第五层:思考与抉择——逻辑推理与综合决策**

在内部模型的沙盘推演基础上,智能体需要进行**逻辑推理**(“因为A和B为真,所以C可能发生”)和**综合决策**。

* 决策器需要综合考虑多重目标:任务目标(如“取回一本书”)、安全约束(如“避开所有障碍”)、效率要求(如“选择最短路径”)以及不确定性(如“如果门关了,执行备用方案”)。

* 这是一个融合了逻辑规则、概率推理和优化算法的复杂过程,其输出是一个或多个待执行的**行动计划**。

#### **第六层:作用于世界——硬件执行**

最终,决策必须转化为物理世界的改变,这通过**硬件执行**环节完成。无论是机械臂的抓取、无人机的飞行、底盘的运动还是屏幕的显示,执行器都将数字世界的指令转化为物理动作。执行精度、响应速度和可靠性,直接决定了智能体行为的成败,并由此产生的新的环境状态变化,又将成为新一轮感知的起点。

#### **结论:闭环智能,螺旋进化**

具身智能的魅力正体现在这个由 **“感知(Sensor -> Acquisition -> Feature) -> 认知(** **环境感知 -> 自我映射 -> 非我识别 -> 规则模拟 -> 小世界建模->事态预测->动态注意力** **) -> 决策(Reasoning -> Decision) -> 行动(Execution)”** 构成的完整智能环中。这个环不是单向的,而是一个闭合的反馈循环。每一次行动都会改变环境,产生新的感知数据,从而验证或修正其内部模型,实现持续的**螺旋式进化**。

因此,开发具身智能的关键在于认识到:**硬件定义了能力的边界,算法决定了智慧的深度,而将二者无缝融合、形成一个高效闭环的系统工程能力,才是真正释放具身智能潜力的核心。** 未来的突破,必将依赖于所有层级的协同创新与共同演进。

通信方式、串口通信)