python网络爬虫小项目(爬取评论)超级简单

学习python网络爬虫的完整路径:

(第一章)

python网络爬虫(第一章/共三章:网络爬虫库、robots.txt规则(防止犯法)、查看获取网页源代码)-CSDN博客![]() https://blog.csdn.net/2302_78022640/article/details/149428719?sharetype=blogdetail&sharerId=149428719&sharerefer=PC&sharesource=2302_78022640&spm=1011.2480.3001.8118(第二章)

https://blog.csdn.net/2302_78022640/article/details/149428719?sharetype=blogdetail&sharerId=149428719&sharerefer=PC&sharesource=2302_78022640&spm=1011.2480.3001.8118(第二章)

python网络爬虫(第二章/共三章:安装浏览器驱动,驱动浏览器加载网页、批量下载资源)-CSDN博客![]() https://blog.csdn.net/2302_78022640/article/details/149431071?sharetype=blogdetail&sharerId=149431071&sharerefer=PC&sharesource=2302_78022640&spm=1011.2480.3001.8118

https://blog.csdn.net/2302_78022640/article/details/149431071?sharetype=blogdetail&sharerId=149431071&sharerefer=PC&sharesource=2302_78022640&spm=1011.2480.3001.8118

(第三章)

python网络爬虫(第三章/共三章:驱动浏览器窗口界面,网页元素定位,模拟用户交互(输入操作、点击操作、文件上传),浏览器窗口切换,循环爬取存储)-CSDN博客![]() https://blog.csdn.net/2302_78022640/article/details/149453182?spm=1011.2124.3001.6209(额外加一个小项目)

https://blog.csdn.net/2302_78022640/article/details/149453182?spm=1011.2124.3001.6209(额外加一个小项目)

即此篇文章

爬取商品好评

完整代码

代码如下:

from selenium import webdriver

from selenium.webdriver.edge.options import Options

from selenium.webdriver.common.by import By

import time# 定义获取页面内容的函数

def get_content(driver):# 等待页面加载完成,可以考虑用 WebDriverWait 来代替 time.sleeptime.sleep(3)# 以追加模式打开文件 '好评.txt',准备写入内容file = open('好评.txt', 'a', encoding='utf-8')# 找到所有 class 为 'body-content' 的元素,这些元素包含评论的正文内容contents = driver.find_elements(By.CLASS_NAME, 'body-content')# 遍历所有找到的评论内容for content in contents:# 给予写入文件内容的时间time.sleep(3)# 将评论文本写入文件file.write(content.text)file.write('\n')# 写入完成后关闭文件file.close()# 配置 Edge 浏览器选项

edge_options = Options()

# 设置 Edge 浏览器的二进制路径

edge_options.binary_location = r"C:\Program Files (x86)\Microsoft\Edge\Application\msedge.exe"

# 初始化 Edge 浏览器驱动

driver = webdriver.Edge(options=edge_options)# 打开指定的 URL 网页

driver.get("https://review.suning.com/cluster_cmmdty_review/cluster-38249278-000000012389328846-0000000000-1-good.htm?originalCmmdtyType=general&safp=d488778a.10004.loverRight.166")# 调用 get_content 函数获取当前页面的评论内容

get_content(driver)# 获取“下一页”按钮

next_rv_maidian = driver.find_element(By.CSS_SELECTOR, '.next.rv-maidian')# 使用 while 循环来点击“下一页”按钮并继续抓取页面评论

while next_rv_maidian != []:# 获取“下一页”按钮元素next_rv_maidian = driver.find_element(By.CSS_SELECTOR, '.next.rv-maidian')# 点击“下一页”按钮next_rv_maidian.click()# 获取当前页的评论内容get_content(driver)

如何寻找页面元素:

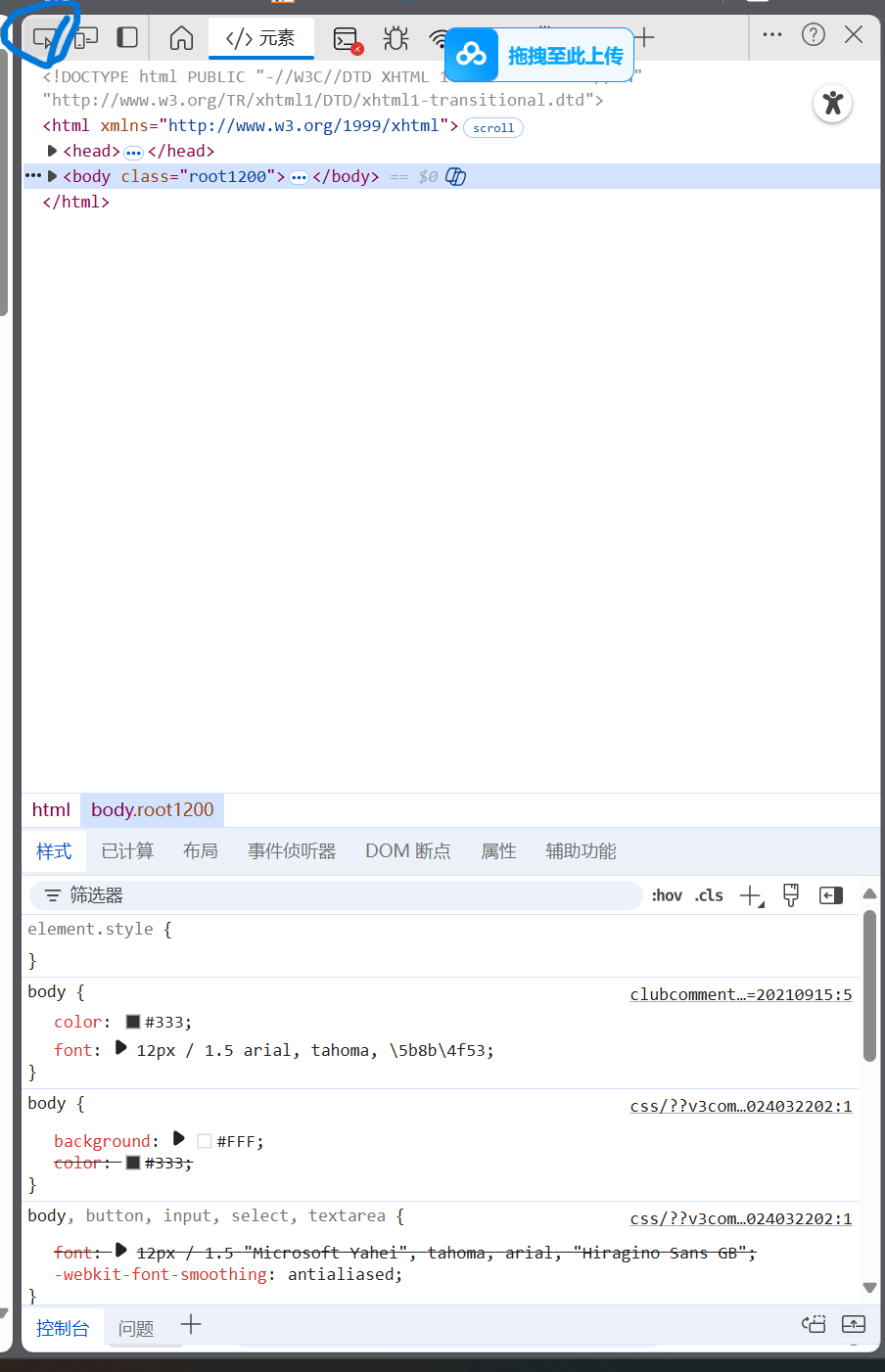

网页右键检查,

点击左上角按键:

点击左方要爬取的内容:

观察到右边:class="body-content"

此行代码即可捕获相应内容:

contents = driver.find_elements(By.CLASS_NAME, 'body-content')![]()

:vlan/DHCP/Web/HTTP/动态PAT/静态NAT)

如何在工厂MOM功能设计和系统落地)

Finite State Machines 更新中...)

)