安装 containerd

需要在集群内的每个节点上都安装容器运行时(containerd runtime),这个软件是负责运行容器的软件。

1. 启动 ipv4 数据包转发

# 设置所需的 sysctl 参数,参数在重新启动后保持不变

cat <<EOF | sudo tee /etc/sysctl.d/k8s.conf

net.ipv4.ip_forward = 1

EOF# 应用 sysctl 参数而不重新启动

sudo sysctl --system然后使用 sysctl net.ipv4.ip_forward 验证是否设置成功

2. 安装 containerd runtime

sudo apt-get update && sudo apt-get install -y containerd3. 创建默认的配置文件

sudo mkdir -p /etc/containerd

containerd config default | sudo tee /etc/containerd/config.toml4. 配置 systemd cgroup 驱动

在 /etc/containerd/config.toml 中找到如下位置,将 SystemdCgroup 设置为 true

[plugins."io.containerd.grpc.v1.cri".containerd.runtimes.runc]...[plugins."io.containerd.grpc.v1.cri".containerd.runtimes.runc.options]SystemdCgroup = true5. 重启 containerd,并设置开机自启动

sudo systemctl restart containerd

sudo systemctl enable containerd安装 kubeadm, kubelet, kubectl

1. 安装必要依赖

# apt-transport-https 可能是一个虚拟包(dummy package);如果是的话,你可以跳过安装这个包

sudo apt-get install -y apt-transport-https ca-certificates curl2. 下载用于 Kubernetes 软件包仓库的公共签名密钥

# 如果 `/etc/apt/keyrings` 目录不存在,则应在 curl 命令之前创建它,请阅读下面的注释。

# sudo mkdir -p -m 755 /etc/apt/keyrings

curl -fsSL https://pkgs.k8s.io/core:/stable:/v1.33/deb/Release.key | sudo gpg --dearmor -o /etc/apt/keyrings/kubernetes-apt-keyring.gpg

3. 添加 Kubernetes apt 仓库。

# 此操作会覆盖 /etc/apt/sources.list.d/kubernetes.list 中现存的所有配置。

echo 'deb [signed-by=/etc/apt/keyrings/kubernetes-apt-keyring.gpg] https://pkgs.k8s.io/core:/stable:/v1.33/deb/ /' | sudo tee /etc/apt/sources.list.d/kubernetes.list4. 更新 apt 包索引,安装 kubelet、kubeadm 和 kubectl,并锁定其版本:

sudo apt-get update

sudo apt-get install -y kubelet kubeadm kubectl

sudo apt-mark hold kubelet kubeadm kubectl# 立即启用 kubelet

sudo systemctl enable --now kubeletmaster节点初始化控制平面

以下操作仅需要在 master 节点执行

1. 初始化

sudo kubeadm init \--apiserver-advertise-address=10.150.1.90 \--pod-network-cidr=10.244.0.0/16 \注意 --pod-network-cidr 参数,这个跟你实际安装的网络插件有关,指明 Pod 网络可以使用的 IP 地址段。

注意此指令执行成功之后,你会得到类似于如下的输出:

Your Kubernetes control-plane has initialized successfully!To start using your cluster, you need to run the following as a regular user:mkdir -p $HOME/.kubesudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/configsudo chown $(id -u):$(id -g) $HOME/.kube/configYou should now deploy a Pod network to the cluster.

Run "kubectl apply -f [podnetwork].yaml" with one of the options listed at:/docs/concepts/cluster-administration/addons/You can now join any number of machines by running the following on each node

as root:kubeadm join <control-plane-host>:<control-plane-port> --token <token> --discovery-token-ca-cert-hash sha256:<hash>记住最后的 kubeadm join ,这是从节点加入集群的指令。

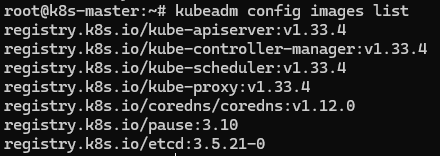

kubeadm init 过程中,需要从官方下载一系列的镜像,可以通过 kubeadm config images list 指令查看

而这些镜像呢,你大概率也是下不下来的,你可以去找替换的源,然后通过 --image-repository 参数来替换,但是我实在是没有找到,因此我的做法是,用翻墙工具将这几个官方源下载到本地,打上 tag 推送到我私有的 nexus 仓库中,比如 registry.k8s.io/kube-apiserver:v1.33.4 会打 tag 成为 walli.nexus.repo/kube-apiserver:v1.33.4,这样初始化的指令就变成了

sudo kubeadm init \--image-repository=walli.nexus.repo \--apiserver-advertise-address=10.150.1.90 \--pod-network-cidr=10.244.0.0/16 \2. 配置 kubectl

非root用户:

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/configroot用户:

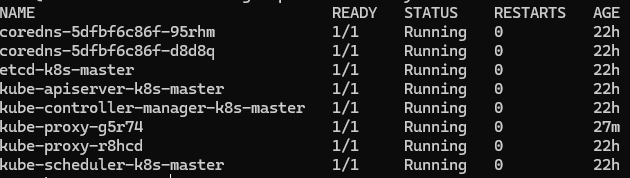

export KUBECONFIG=/etc/kubernetes/admin.conf当你完成 kubeadm init 之后,你可以使用指令 kubectl get pods -n kube-system 查看当前有一些容器已经起来了,其中 coredns 应该并不会启动,因为你还没有安装网络插件,这个容器需要等到网络插件安装好之后才会正常启动。

安装 Pod 网络插件(CNI)

kubernetes 支持很多种网络插件,具体可参考 安装扩展(Addon) | Kubernetes

本文就使用最简单的 Flannel 插件

kubectl apply -f https://github.com/flannel-io/flannel/releases/latest/download/kube-flannel.yml

注意这个 yml 中也有一些镜像,我也是通过翻墙下载,打上私有 tag 的方式部署的。yml 内容可参考《附录-kube-flannel.yml》

另外,flannel 使用的 bridge 的方式桥接网络,但是操作系统相关的配置可能不正确,因此你需要做如下检查:

- 使用指令 lsmod | grep bridge 检查是否已经启用模块,如果没有任何输出表示没有启用,通过如下指令启用:

sudo modprobe bridge sudo modprobe br_netfilter - 设置 sysctl ,编辑文件 /etc/sysctl.d/k8s.conf,添加如下设置:

net.bridge.bridge-nf-call-ip6tables = 1 net.bridge.bridge-nf-call-iptables = 1然后 sudo sysctl --system 重启。注意,这个设置 bridge 的操作,主节点从节点均需要执行。

如果之前网络插件有失败的安装,可以使用 kubectl delete -f kube-flanne.yml 来删除之前的安装。

安装好 Pod 网络插件之后,再使用 kubectl get pods -n kube-system 就能看到 coredns 也正常了

从节点加入集群

在从节点上,使用 kubeadm init 时输出的 join 指令,加入到集群

sudo kubeadm join 192.168.1.10:6443 --token <your-token> --discovery-token-ca-cert-hash <your-hash>如果你忘记了这个指令,可以在 master 节点上使用 kubeadm token create --print-join-command 重新生成一个。这个指令有效期是24小时,如果过了一段时间有其他节点需要加入集群,一样操作即可。

加入集群成功之后,使用 kubectl get node 你可以看到集群信息

附录

kube-flannel.yml 内容

apiVersion: v1

kind: Namespace

metadata:labels:k8s-app: flannelpod-security.kubernetes.io/enforce: privilegedname: kube-flannel

---

apiVersion: v1

kind: ServiceAccount

metadata:labels:k8s-app: flannelname: flannelnamespace: kube-flannel

---

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRole

metadata:labels:k8s-app: flannelname: flannel

rules:

- apiGroups:- ""resources:- podsverbs:- get

- apiGroups:- ""resources:- nodesverbs:- get- list- watch

- apiGroups:- ""resources:- nodes/statusverbs:- patch

---

apiVersion: rbac.authorization.k8s.io/v1

kind: ClusterRoleBinding

metadata:labels:k8s-app: flannelname: flannel

roleRef:apiGroup: rbac.authorization.k8s.iokind: ClusterRolename: flannel

subjects:

- kind: ServiceAccountname: flannelnamespace: kube-flannel

---

apiVersion: v1

data:cni-conf.json: |{"name": "cbr0","cniVersion": "0.3.1","plugins": [{"type": "flannel","delegate": {"hairpinMode": true,"isDefaultGateway": true}},{"type": "portmap","capabilities": {"portMappings": true}}]}net-conf.json: |{"Network": "10.244.0.0/16","EnableNFTables": false,"Backend": {"Type": "vxlan"}}

kind: ConfigMap

metadata:labels:app: flannelk8s-app: flanneltier: nodename: kube-flannel-cfgnamespace: kube-flannel

---

apiVersion: apps/v1

kind: DaemonSet

metadata:labels:app: flannelk8s-app: flanneltier: nodename: kube-flannel-dsnamespace: kube-flannel

spec:selector:matchLabels:app: flannelk8s-app: flanneltemplate:metadata:labels:app: flannelk8s-app: flanneltier: nodespec:affinity:nodeAffinity:requiredDuringSchedulingIgnoredDuringExecution:nodeSelectorTerms:- matchExpressions:- key: kubernetes.io/osoperator: Invalues:- linuxcontainers:- args:- --ip-masq- --kube-subnet-mgrcommand:- /opt/bin/flanneldenv:- name: POD_NAMEvalueFrom:fieldRef:fieldPath: metadata.name- name: POD_NAMESPACEvalueFrom:fieldRef:fieldPath: metadata.namespace- name: EVENT_QUEUE_DEPTHvalue: "5000"- name: CONT_WHEN_CACHE_NOT_READYvalue: "false"image: walli.nexus.repo/flannel:v0.27.2 # 修改此处为私有镜像name: kube-flannelresources:requests:cpu: 100mmemory: 50MisecurityContext:capabilities:add:- NET_ADMIN- NET_RAWprivileged: falsevolumeMounts:- mountPath: /run/flannelname: run- mountPath: /etc/kube-flannel/name: flannel-cfg- mountPath: /run/xtables.lockname: xtables-lockhostNetwork: trueinitContainers:- args:- -f- /flannel- /opt/cni/bin/flannelcommand:- cpimage: walli.nexus.repo/flannel-cni-plugin:v1.7.1-flannel1 # 修改此处为私有镜像name: install-cni-pluginvolumeMounts:- mountPath: /opt/cni/binname: cni-plugin- args:- -f- /etc/kube-flannel/cni-conf.json- /etc/cni/net.d/10-flannel.conflistcommand:- cpimage: walli.nexus.repo/flannel:v0.27.2 # 修改此处为私有镜像name: install-cnivolumeMounts:- mountPath: /etc/cni/net.dname: cni- mountPath: /etc/kube-flannel/name: flannel-cfgpriorityClassName: system-node-criticalserviceAccountName: flanneltolerations:- effect: NoScheduleoperator: Existsvolumes:- hostPath:path: /run/flannelname: run- hostPath:path: /opt/cni/binname: cni-plugin- hostPath:path: /etc/cni/net.dname: cni- configMap:name: kube-flannel-cfgname: flannel-cfg- hostPath:path: /run/xtables.locktype: FileOrCreatename: xtables-lock

——论文阅读)

)

)