AI大模型相信已经成为许多人工作和生活中的得力助手。然而,对于大多数普通用户而言,将强大的AI模型部署到自己的电脑上,似乎是一项遥不可及的技术活,往往涉及到复杂的命令行操作、环境配置和代码调试。

那有没有一种工具,能让完全没有技术背景的“小白”用户,也能轻松实现AI本地化部署,享受安全、私密、便捷的AI体验呢?今天,我们就来详细介绍一款专为零基础用户设计的AI部署工具。

AI部署工具:【DS本地部署大师】

简单来说,这是一款Windows系统AI部署工具,它的核心是将复杂的AI大模型本地部署流程,简化为像安装普通软件一样的“一键式”操作。用户无需关心背后复杂的技术细节,只需通过简单的图形化界面点击,就能将DeepSeek、通义千问等主流AI模型安装到自己的电脑上运行。

它具备以下特点:

- 对小白友好:完全图形化界面,操作简单,无需任何编程基础。

- 部署便捷:集成模型下载、环境配置、部署和体验入口于一体,流程简化。

- 模型管理方便:在界面中清晰展示可选模型及版本,方便根据需求和硬件选择。

- 功能丰富:支持本地、在线和联网搜索,提供更灵活的AI交互体验。

- 注重数据安全:本地运行模式,保障数据隐私。

与Ollama等AI部署工具相比,它们之间的区别如下:

特性 | DS本地部署大师 | Ollama |

目标用户 | 零基础用户、普通办公人员 | 开发者、有一定编程基础的技术人员 |

安装复杂度 | 一键安装,图形化向导 | 需配置Python/CUDA环境,命令行操作 |

交互方式 | 图形化界面(对话窗口+功能按钮) | 命令行/API调用 |

多模型管理 | 可视化模型切换,支持多模型共存 | 需手动切换模型文件 |

联网功能 | 内置在线模型(DeepSeek/文心一言等)+联网搜索 | 需自行开发集成 |

数据安全 | 本地运行+可选在线混合模式 | 完全本地运行 |

跨平台支持 | 目前仅Windows | Windows/macOS/Linux |

适合场景 | 快速体验、日常办公、隐私敏感任务 | 二次开发、研究、定制化需求 |

很显然,与Ollama等面向开发者的命令行工具相比,【DS本地部署大师】的目标用户非常明确,就是AI初学者、普通办公人员、以及注重操作简便性和数据隐私,部署起来非常简单。

接下来,我们将一步步演示如何使用它完成AI模型的本地部署。

一、准备工作

硬件与系统要求

本地部署大语言模型对电脑硬件有一定要求,尤其是显卡。通常来说,拥有NVIDIA显卡(建议RTX 20系列及以上,显存不低于8GB)的Windows电脑可以获得较好的体验。具体配置要求可以参考下表:

二、部署步骤

第一步:下载与安装软件

访问该工具官网,下载最新版本的安装包,下载完成后,双击安装包,会弹出标准的软件安装向导,以点击“自定义安装”,选择一个合适的安装路径(建议选择非系统盘),然后按照提示点击“下一步”或“立即安装”,直至安装完成。

第二步:选择并部署模型

安装完成后,打开软件,点击界面下方的“下载模型”,会清晰地展示可供部署的AI模型列表,其中会包括deepseek-r1系列、Qwen系列等AI模型可以选择。

在这些AI模型中,会清晰的标注出每个AI模型建议用什么电脑配置,包括容量、内存、CPU、显存等,如果你的硬件配置非常高,可以尝试大参数的模型。

选择好模型后,点击界面下方的“点击立即部署本地环境”,软件会自动开始下载模型文件并进行本地配置。这个过程可能需要一些时间,具体取决于你的网络速度和模型文件的大小,只需耐心等待进度条走完即可。

第三步:部署完成,开始与AI对话

部署完成后软件会自动切换到对话界面,此时,可以在对话框中输入问题,与本地的AI进行交流了。集成了本地快速模式、在线AI模型(如DeepSeek、千问、豆包、文心一言)和联网搜索功能,使用起来更加灵活。

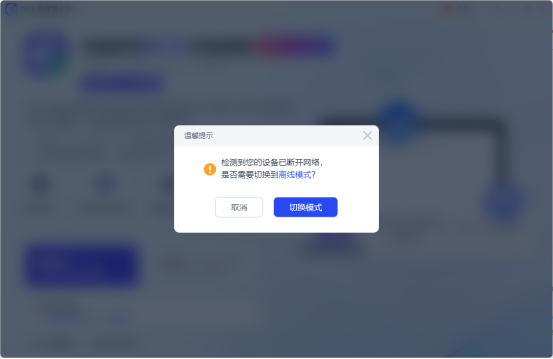

什么?没有网络能不能使用?答案当然可以使用,一旦该工具检测到电脑断开了网络,就会弹出一个切换窗口,点击“切换模式”就可以进入到离线模式的AI对话界面,可以正常使用,适合在飞机、高铁、地下室等无信号或信号不佳的地方使用。

例如,你可以与部署完成后的AI模型进行对话:

提问: “帮我起草一封内部邮件,内容是关于第三季度项目复盘会议的通知。需要强调会议内容的重要性及保密性,参会人员为项目部全体成员,时间是下周三下午两点,地点在301会议室。”

它会先思考并给出详细回答

通过极致简化的操作流程,可以将专业级的AI本地部署带给了每一位普通用户。如果你也一直对本地AI充满好奇但又苦于技术门槛,或者您在日常工作中需要一个绝对安全的AI助手,那么这款“开箱即用”的工具,不妨去亲身体验一下,希望能够帮助到大家。

服务商发展趋势与企业赋能白皮书)

)

:原理、实现与应用)