论文地址:https://arxiv.org/pdf/2505.20774

代码地址:https://github.com/xwmaxwma/TimePro

为了更好地理解时间序列模型的理论与实现,推荐参考UP “ThePPP时间序列” 的教学视频。该系列内容系统介绍了时间序列相关知识,并提供配套的论文资料与代码示例,有助于理论与实践相结合。

https://space.bilibili.com/613453963

摘要

在长期时间序列预测中,不同的变量通常在不同的时间间隔内影响目标变量,这种挑战被称为多延迟问题。传统的模型通常统一处理所有变量或时间点,这限制了它们捕捉复杂变量关系和获得非平凡时间表示的能力。为了解决这个问题,本研究提出了TimePro,一个创新的基于Mamba的模型,它构建了变量和时间感知的超状态。与仅跨变量或时间维度传递普通状态的传统方法不同,TimePro保留了每个变量标记的细粒度时间特征,并自适应地选择聚焦的时间点来调整普通状态。重建的超状态可以感知变量关系和显著的时间信息,这有助于模型进行准确的预测。在实验中,TimePro在八个真实世界的长期预测基准测试中表现出具有竞争力的性能,并具有令人满意的线性复杂度。

引言

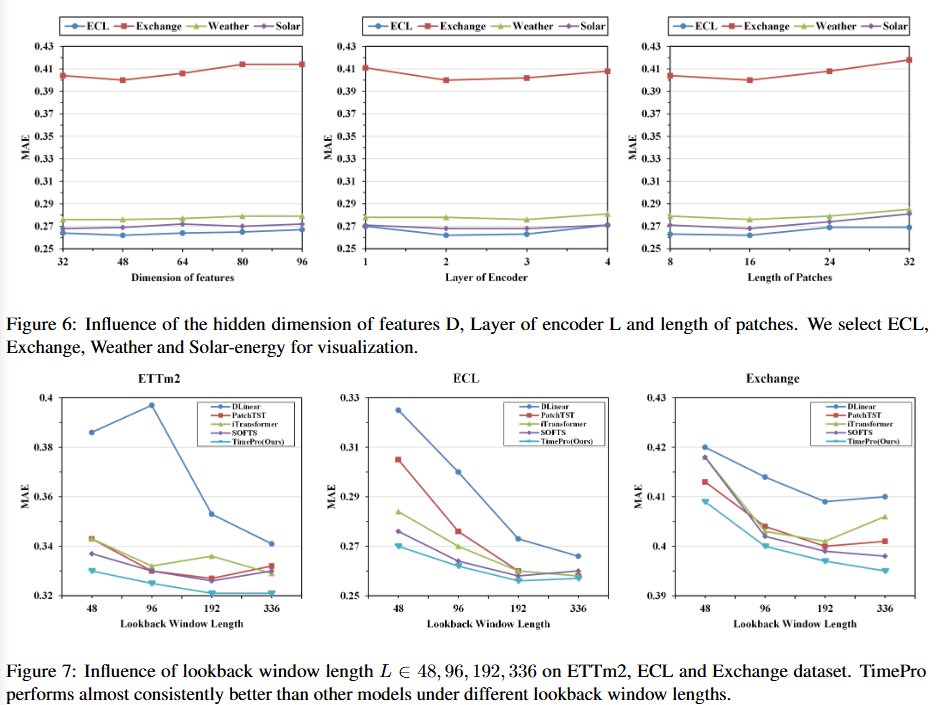

本研究关注多变量长时序预测中的多延迟问题,即不同变量对目标变量的影响时间跨度不同,而现有模型通常对所有变量或时间点进行统一处理,难以捕捉复杂的变量关系和非平凡的时间表示。Mamba模型在时间序列预测中展现了线性计算复杂度和高效的长时依赖性捕获能力等优势,已有多种基于Mamba的模型被提出,例如Bi-Mamba+、S-Mamba、TimeMachine和TSMamba等,它们从不同方向扫描特征,但忽略了多延迟问题。本研究指出现有的Mamba模型和基于Transformer的模型,例如PatchTST和iTransformer,都存在对变量或时间点统一处理的局限性,难以捕捉关键时间点和获得非平凡的时间表示。

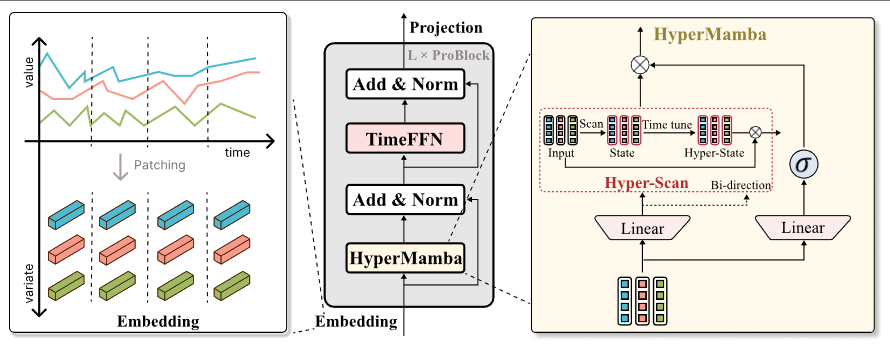

本研究针对多延迟问题提出了一种名为TimePro的创新性基于Mamba的模型,该模型构建了变量感知和时间感知的超状态。与传统方法仅在变量间传递普通状态不同,TimePro保留了每个变量标记的细粒度时间特征,并自适应地选择关注的时间点来调整普通状态。具体来说,本研究首先扫描变量维度以获得包含变量之间相关性的隐藏状态,然后使用专门的网络学习关键时间点的偏移量,并通过自适应地选择这些关键时间点来动态更新隐藏状态,使其反映最显著的时间信息。这种自适应机制使重构的超状态能够整合变量特定信息和细微的时间变化,从而提高模型的预测精度。

本研究提出的时间调整策略通过自适应地选择重要时间点并使用重构的超状态来获得输出,从而调整变量状态。超状态能够感知复杂的变量关系和变量内时间变化,从而有助于实现准确预测。通过结合超状态重构和硬件感知的实现,本研究提出了一个高效的多变量长时序预测模型TimePro。TimePro在多个真实世界数据集上实现了具有竞争力的性能,并显著优于现有的Mamba和基于Transformer的方法,同时保持了线性复杂度,确保了计算效率。

本研究的创新之处在于设计了一种时间调整策略,该策略通过自适应地选择重要时间点并使用重构的超状态来调整变量状态,从而提高了预测的准确性。此外,本研究结合了超状态重构和硬件感知的实现,提出了一个高效的多变量长时序预测模型TimePro。最后,TimePro在八个真实世界数据集上取得了具有竞争力的性能,显著优于现有的Mamba和基于Transformer的方法。

论文创新点

🚀 本研究提出了一个名为TimePro的创新性Mamba模型,用于解决多变量长时间序列预测中的多延迟问题。 🚀

该模型的核心创新在于构建了变量感知和时间感知的超状态。与传统方法简单地在变量或时间维度上传递状态不同,TimePro保留了每个变量标记的细粒度时间特征,并自适应地选择关键时间点来调整普通状态。这种超状态能够感知变量关系和显著的时间信息,从而提高预测精度。

-

⏰ 时间调整策略: ⏰

- 该策略通过自适应地选择重要时间点来调整变量状态,并使用重构的超状态来获得输出。

- 超状态能够感知复杂的变量关系和变量内部时间变化,从而有助于进行准确的预测。

-

💻 硬件感知的实现方式与超状态重构: 💻

- 结合了超状态重构和硬件感知的实现方式,提出了一个高效的多变量长时间序列预测模型TimePro。

- TimePro的硬件感知设计充分利用了GPU内存层次结构,在GPU SRAM上进行普通状态的获取,而在GPU HBM上进行其他操作,从而提高了计算效率。

-

💡 HyperMamba模块的设计: 💡

- 该模块对原始Mamba模型进行了改进,用硬件感知的Hyper Scan取代了选择性扫描,并去除了扫描前后的深度卷积和线性投影,从而在不降低效率的情况下提高了性能。

- 此外,HyperMamba还采用了扫描初始设计,即沿通道的两个部分进行相反变量方向的扫描,从而增强了模型捕捉全局变量依赖关系的能力。

-

📏 线性复杂度: 📏

- TimePro的线性复杂度使其在处理高维数据时更加高效。

- 与基于Transformer的模型(如iTransformer和PatchTST)相比,TimePro在变量数量增加时,内存消耗和推理时间呈线性增长。

-

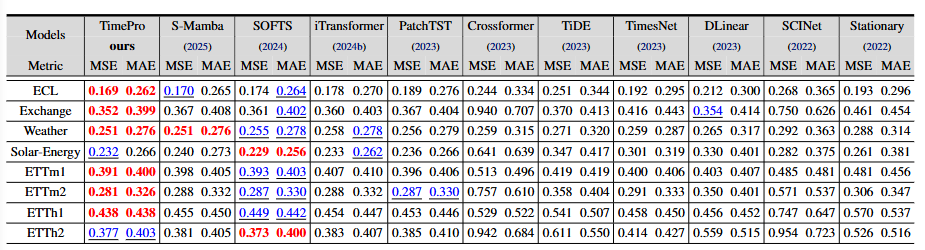

📊 实验结果: 📊

- 本研究在八个真实世界的数据集上进行了实验,结果表明TimePro的性能优于现有的Mamba和Transformer模型。

- TimePro在多个数据集上实现了最先进的性能,并在不同的预测长度和平均值上都具有较小的MSE和MAE。

- 这证明了TimePro在处理多变量长时间序列预测问题上的有效性。

论文实验

)

知识点详解与案例代码(15))

)