[1] WANG C, ZHAO J, JIAO L, 等. When Large Language Models Meet Evolutionary Algorithms: Potential Enhancements and Challenges[A/OL]. arXiv, 2025[2025-08-07]. http://arxiv.org/abs/2401.10510. DOI:10.48550/arXiv.2401.10510.

这篇文章《当大型语言模型遇到进化算法:潜在增强与挑战》探讨了大型语言模型(LLMs)和进化算法(EAs)之间的概念相似性以及它们如何相互增强。文章主要内容包括:

-

概念相似性分析:文章从微观层面分析了LLMs和EAs之间的五个关键概念对应关系:

- 标记表示与个体表示

- 位置编码与适应度塑造

- 位置嵌入与选择

- Transformer块与繁殖

- 模型训练与参数适应

-

进化微调:文章讨论了在黑盒场景下使用进化算法微调LLMs的方法,特别是进化提示调整和自我调整技术,这些技术不需要访问模型内部信息,成本较低。

-

LLM增强的进化算法:文章探讨了如何利用LLMs作为进化算法中的繁殖和变异算子,通过自然语言描述来表示复杂的个体,如路径、数学表达式、代码等。

-

挑战与未来方向:文章指出了当前研究面临的挑战,包括资源管理、灾难性遗忘、适应性评估和安全问题,并提出了未来研究方向。

文章的核心观点是,LLMs和EAs在处理序列数据方面具有共同的方向性和集体性特征,通过理解它们之间的概念相似性,可以促进两个领域的技术进步和创新。这种交叉研究有望创造出能够从已有知识中学习同时不断探索新知识的人工智能代理。

在论文《当大型语言模型遇到进化算法:潜在增强与挑战》中,图1(Fig. 1) 主要用于说明大型语言模型(LLMs)与进化算法(EAs)在概念结构上的对应关系。以下是该图的核心内容解析:

🧩 图1的主要内容概述

图1通过结构化对比图,展示了LLMs和EAs在五个关键概念上的相似性,旨在揭示两者在机制设计上的内在联系。这些对应关系如下:

| 大型语言模型(LLMs) | 进化算法(EAs) | 对应说明 |

|---|---|---|

| 标记表示(Token Representation) | 个体表示(Individual Representation) | LLM中的每个token对应EA中的一个个体,代表基本的信息单元 |

| 位置编码(Positional Encoding) | 适应度塑造(Fitness Shaping) | 位置信息为token赋予顺序意义,类似EA中适应度函数塑造个体优劣 |

| 位置嵌入(Positional Embedding) | 选择(Selection) | 嵌入机制决定哪些token更重要,类似于EA中选择机制决定哪些个体进入下一代 |

| Transformer块(Transformer Block) | 繁殖(Reproduction) | Transformer通过自注意力机制处理token间关系,类似EA中的交叉与变异操作 |

| 模型训练(Model Training) | 参数适应(Parameter Adaptation) | LLM通过训练优化权重,EA通过迭代优化种群参数 |

🎯 图1的学术意义

-

建立跨领域概念桥梁:

- 图1首次系统性地将LLMs和EAs的核心组件进行映射,为两个领域的研究者提供了统一的理解框架。

-

启发交叉研究思路:

- 通过揭示LLMs与EAs在结构上的相似性,图1为将进化算法引入LLM优化(如进化微调)和用LLMs增强进化算法(如用语言模型生成变异策略)提供了理论依据。

-

支持后续实验设计:

- 图1中的概念对应关系为论文中后续的实验设计(如进化提示调整、LLM作为变异算子等)奠定了基础。

Large language model-enhanced evolutionary algorithm

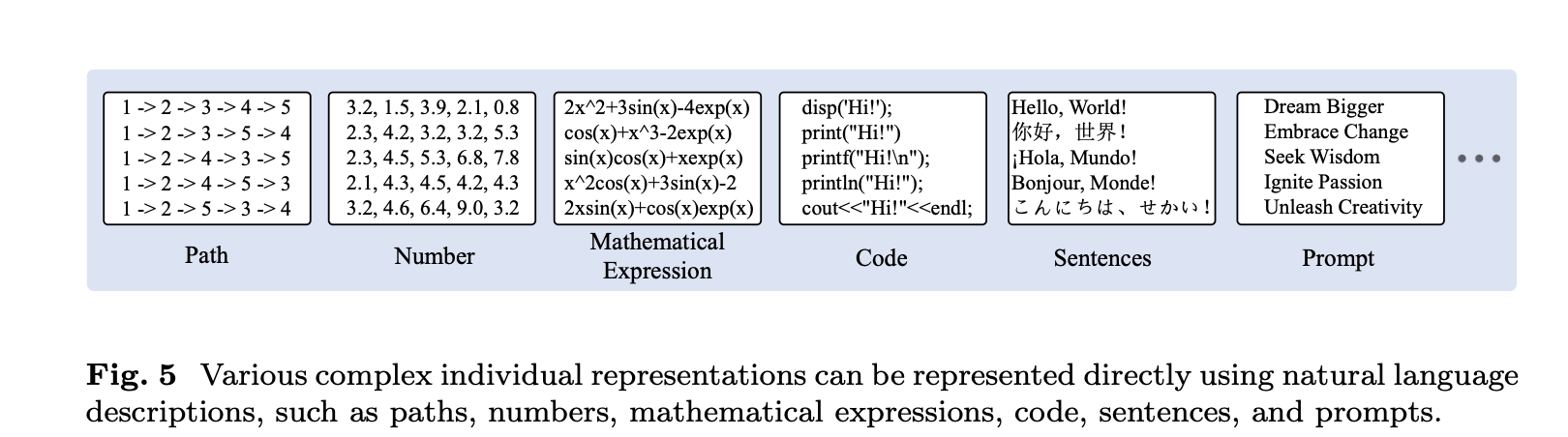

传统的进化算法中,个体通常以向量、树结构、图等形式表示。图5展示了一种更灵活的表示方法:用自然语言描述个体。例如:

- 路径规划问题:个体可以表示为“从A出发,经过B和C,最终到达D的最短路径”。

- 数学表达式优化:个体可以描述为“一个用于拟合数据的二次多项式”。

- 程序生成:个体可以是一段自然语言描述的代码逻辑。

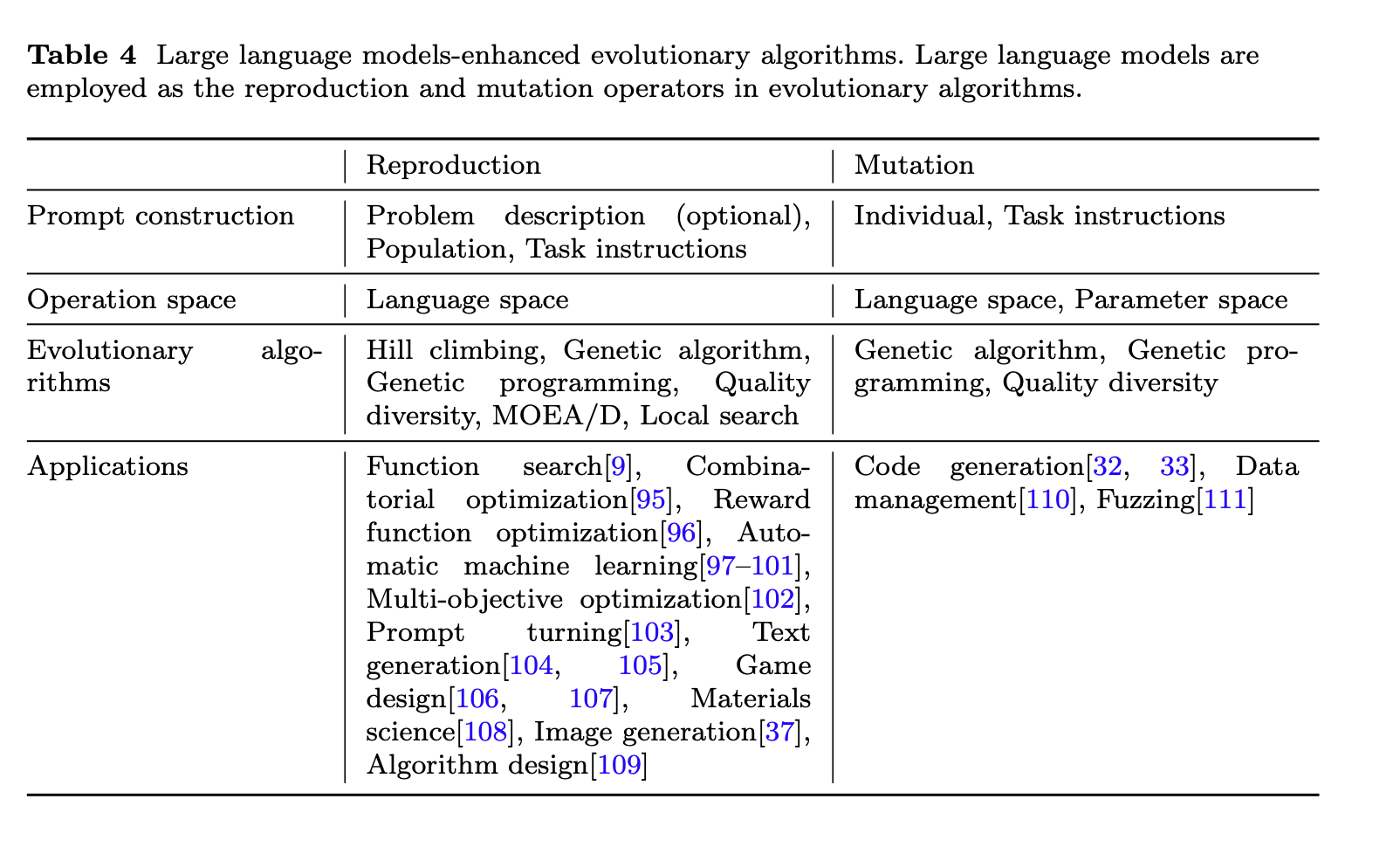

表4总结了LLM增强的进化算法,其中LLMs被用作繁殖(reproduction)和变异(mutation)算子。这些方法通过基于LLM的进化算子来维持种群,以寻找复杂现实世界问题的多样化解决方案。

LLM-based reproduction 是指利用LLMs从父代种群中生成后代(offspring)的过程。这一过程的核心是提示(prompt),提示通常包含以下三部分:

- 问题描述(可选):提供问题的背景信息,帮助LLM理解任务目标。

- 父代种群(parent population):

- 任务指令(task instructions):

LLMs根据这些提示,应用任务指令到父代种群上,生成新的后代个体。这一过程完全在语言空间中完成,无需访问模型的内部参数,因此成本较低。

LLM-based reproduction 的优势

- 语言空间操作:LLMs直接在自然语言空间中生成后代,无需访问模型的内部参数(如权重或梯度)。

- 成本节约:传统进化算法可能需要大量计算资源(如梯度计算、参数优化),而LLM-based reproduction仅需文本生成,显著降低成本。

- 灵活性:适用于多种问题类型(如程序生成、架构设计、路径规划等),只需调整提示即可适应不同任务。

大型语言模型(LLMs)作为变异算子(mutation operator):

例如:“父代代码:def add(a, b): return a + b。”

例如:“将上述代码修改为支持三个参数的加法函数。”

)

)

)