1. 项目概述

Letta(前身为 MemGPT)是一个用于构建有状态AI代理的开源框架,专注于提供长期记忆和高级推理能力。该项目是MemGPT研究论文的实现,引入了"LLM操作系统"的概念用于内存管理。

核心特点

- 有状态代理:具有持久化内存的AI代理

- 长期记忆管理:分层内存架构

- 自我编辑能力:代理可以修改自己的记忆和个性

- 白盒架构:透明的内存管理机制

- 模型无关:支持多种LLM后端

2. 技术栈分析

后端架构

- Web框架: FastAPI + Starlette

- 数据库: PostgreSQL (推荐) / SQLite (开发用)

- 向量数据库: Chroma 或 pgvector

- API架构: RESTful API + Server-Sent Events (SSE)

前端技术

- 框架: React + Vite

- 样式: Tailwind CSS

- 界面: Agent Development Environment (ADE)

开发语言与工具

- 主要语言: Python

- SDK支持: Python SDK 和 TypeScript SDK

- 依赖管理: Poetry

- 容器化: Docker

- API规范: OpenAPI规范,使用Fern生成客户端库

3. 优势与劣势分析

优势

- 突破性的内存架构

- 分层内存系统:核心内存(persona+用户信息)和归档内存(向量数据库)

- 自我编辑能力,能够跨交互保持长期记忆

- 生产就绪的架构

- 基于PostgreSQL的持久化存储

- RESTful API设计

- Docker化部署

- 开发者友好

- 提供Python和TypeScript SDK

- 可视化开发环境ADE

- 详细的文档和API参考

- 灵活的模型支持

- 支持OpenAI、Anthropic、vLLM、Ollama等多种后端

劣势

- 复杂性较高

- 内存管理机制相对复杂

- 需要理解分层内存概念

- 数据迁移限制

- SQLite版本不支持数据库迁移

- 生产环境必须使用PostgreSQL

- 资源消耗

- 向量数据库需要额外存储和计算资源

- 长期运行可能产生大量历史数据

4. 使用场景

- 客户服务机器人

- 记住用户历史对话和偏好

- 提供个性化服务体验

- 个人助理应用

- 学习用户习惯和工作模式

- 提供上下文相关的建议

- 教育培训系统

- 跟踪学习者进度

- 适应个体学习风格

- 企业知识管理

- 构建智能知识库

- 支持复杂查询和推理

- 游戏AI角色

- 创建有记忆的NPC

- 根据玩家行为演化

5. 代码结构分析

核心组件架构

letta/

├── server/ # API服务器

├── client/ # 客户端SDK

├── agent/ # 代理核心逻辑

├── memory/ # 内存管理

├── functions/ # 工具函数

├── embeddings/ # 向量嵌入

└── schemas/ # 数据模式内存架构设计

- 核心内存 (Core Memory)

- Persona Block: 代理人格设定

- Human Block: 用户信息

- 归档内存 (Archival Memory)

- 向量数据库存储

- 语义搜索能力

- 召回内存 (Recall Memory)

- 对话历史管理

- 上下文窗口控制

6. 主要执行步骤

代理初始化流程

- 加载预设人格和用户配置

- 初始化核心内存块

- 连接向量数据库

- 设置工具函数集

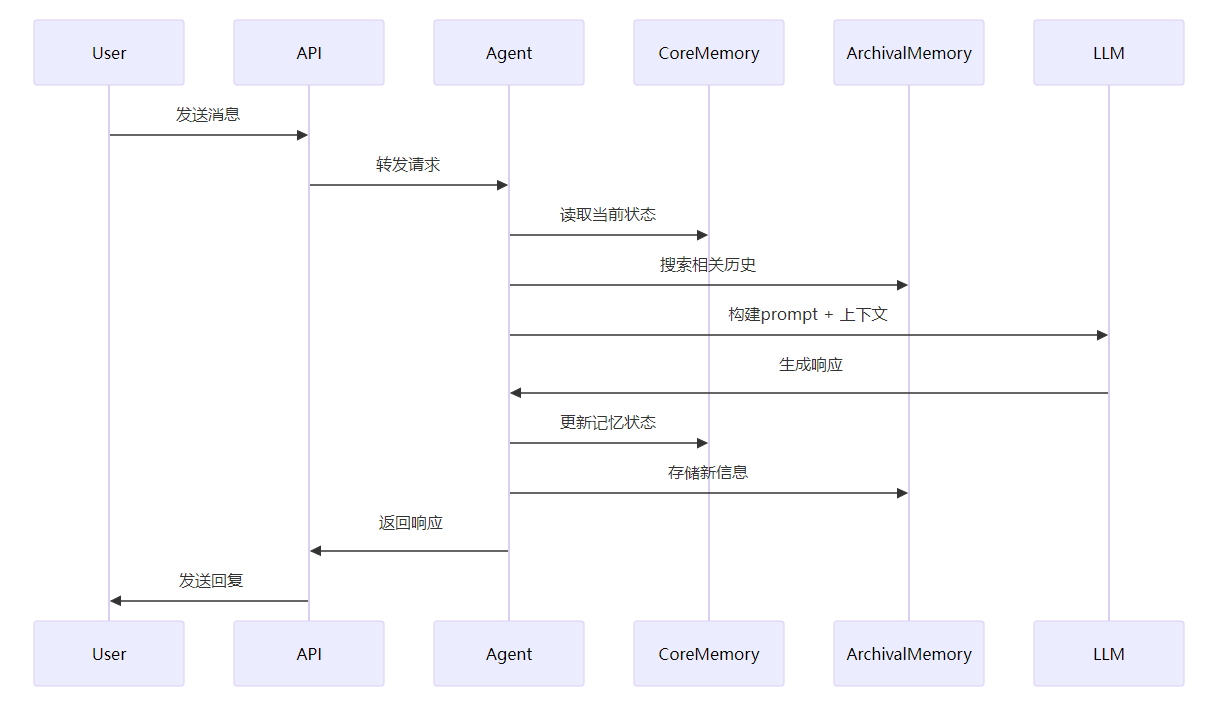

消息处理流程

- 接收用户输入

- 搜索相关历史记忆

- 构建上下文窗口

- LLM推理生成响应

- 更新内存状态

- 返回响应给用户

7. 时序图

8. 开发示例代码

基础代理创建示例

python

from letta import create_client# 创建客户端

client = create_client()# 创建代理

agent_state = client.create_agent(name="MyAssistant",persona="我是一个友善的助手,专门帮助用户解决问题。",human="用户是一个对AI技术感兴趣的开发者。",tools=["send_message", "archival_memory_search"]

)# 与代理对话

response = client.user_message(agent_id=agent_state.id,message="你好,请介绍一下你的能力"

)print(response.messages[-1].text)自定义工具函数示例

python

from letta.functions.schema import ToolFunctiondef get_weather(location: str) -> str:"""获取指定位置的天气信息"""# 模拟天气API调用return f"{location}今天晴朗,温度25°C"# 注册工具函数

weather_tool = ToolFunction(name="get_weather",description="获取天气信息",function=get_weather

)# 创建带有自定义工具的代理

agent = client.create_agent(name="WeatherBot",tools=["send_message", "get_weather"]

)内存管理示例

python

# 更新代理人格

client.update_agent_core_memory(agent_id=agent.id,field="persona",value="我是一个专业的天气播报员,提供准确的天气信息。"

)# 搜索归档记忆

search_results = client.search_archival_memory(agent_id=agent.id,query="天气预报",count=5

)# 添加信息到归档记忆

client.insert_archival_memory(agent_id=agent.id,content="用户经常询问北京的天气情况"

)9. 二次开发建议

1. 架构扩展建议

- 多租户支持: 为企业应用添加用户隔离

- 插件系统: 开发标准化的工具插件接口

- 缓存优化: 添加Redis缓存层提升性能

- 监控体系: 集成APM工具监控代理性能

2. 功能增强方向

- 情感分析: 集成情感识别增强交互体验

- 多模态支持: 扩展支持图片、语音输入

- 知识图谱: 结合图数据库增强推理能力

- 实时学习: 实现增量学习机制

3. 性能优化策略

- 异步处理: 使用消息队列处理长时间任务

- 内存优化: 实现智能内存清理机制

- 批处理: 支持批量操作减少数据库访问

- 索引优化: 优化向量数据库索引策略

4. 安全性加固

- 权限控制: 实现细粒度的API权限管理

- 数据加密: 对敏感内存数据进行加密存储

- 审计日志: 添加完整的操作审计功能

- 输入验证: 加强用户输入的安全验证

5. 生产部署优化

- 容器编排: 使用Kubernetes进行集群部署

- 负载均衡: 实现代理负载分布

- 备份策略: 制定数据备份和恢复方案

- 监控告警: 建立完善的监控告警体系

6. 开发工具链

- 测试框架: 建立自动化测试体系

- CI/CD: 集成持续集成和部署流水线

- 文档生成: 自动化API文档生成

- 开发环境: 提供docker-compose开发环境

总结

Letta是一个极具创新性的AI代理框架,其独特的内存管理架构为构建真正智能的对话系统提供了新的可能。虽然在复杂性和资源消耗方面存在一定挑战,但其在长期记忆和状态管理方面的突破使其成为下一代AI应用的重要基础设施。

对于开发者而言,Letta不仅提供了完整的技术框架,还通过ADE等工具降低了开发门槛。随着AI代理技术的发展,Letta有望成为该领域的重要标准之一。

------休眠函数sleep_for和sleep_until)

②)

![[frontend]mermaid code2image](http://pic.xiahunao.cn/[frontend]mermaid code2image)

)

)

(3))

——微调Transformer语言模型进行多标签文本分类)