简介:

元景万悟智能体平台是一款面向企业级场景的一站式、商用license友好的智能体开发平台,是业界第一款go语言(后端)开发的智能体开发平台(7月19日),coze studio开源是7月26日,同时也是央企首个开源的智能体开发平台,并且支持多租户,其他开源的项目基本都不支持多租户或者多租户会受license限制,需要商业授权,但是元景万悟的license非常友好,可以免费使用多租户功能,这点非常值得点赞!!!

部署:

克隆项目:

git clone https://github.com/UnicomAI/wanwu.gitDocker安装:

-

首次运行前

1.1 拷贝环境变量文件

cp .env.bak .env1.2 根据系统修改.env文件中的

WANWU_ARCH、WANWU_EXTERNAL_IP变量# amd64 / arm64 WANWU_ARCH=amd64# external ip port(注意localhost要换成本机局域网或对外IP,例如192.168.0.xx,不能是localhost或127.0.0.1) WANWU_EXTERNAL_IP=localhost1.3 创建docker运行网络

docker network create wanwu-net -

启动服务(首次运行会自动从Docker Hub拉取镜像)

# amd64系统执行: docker compose --env-file .env --env-file .env.image.amd64 up -d # arm64系统执行: docker compose --env-file .env --env-file .env.image.arm64 up -d

-

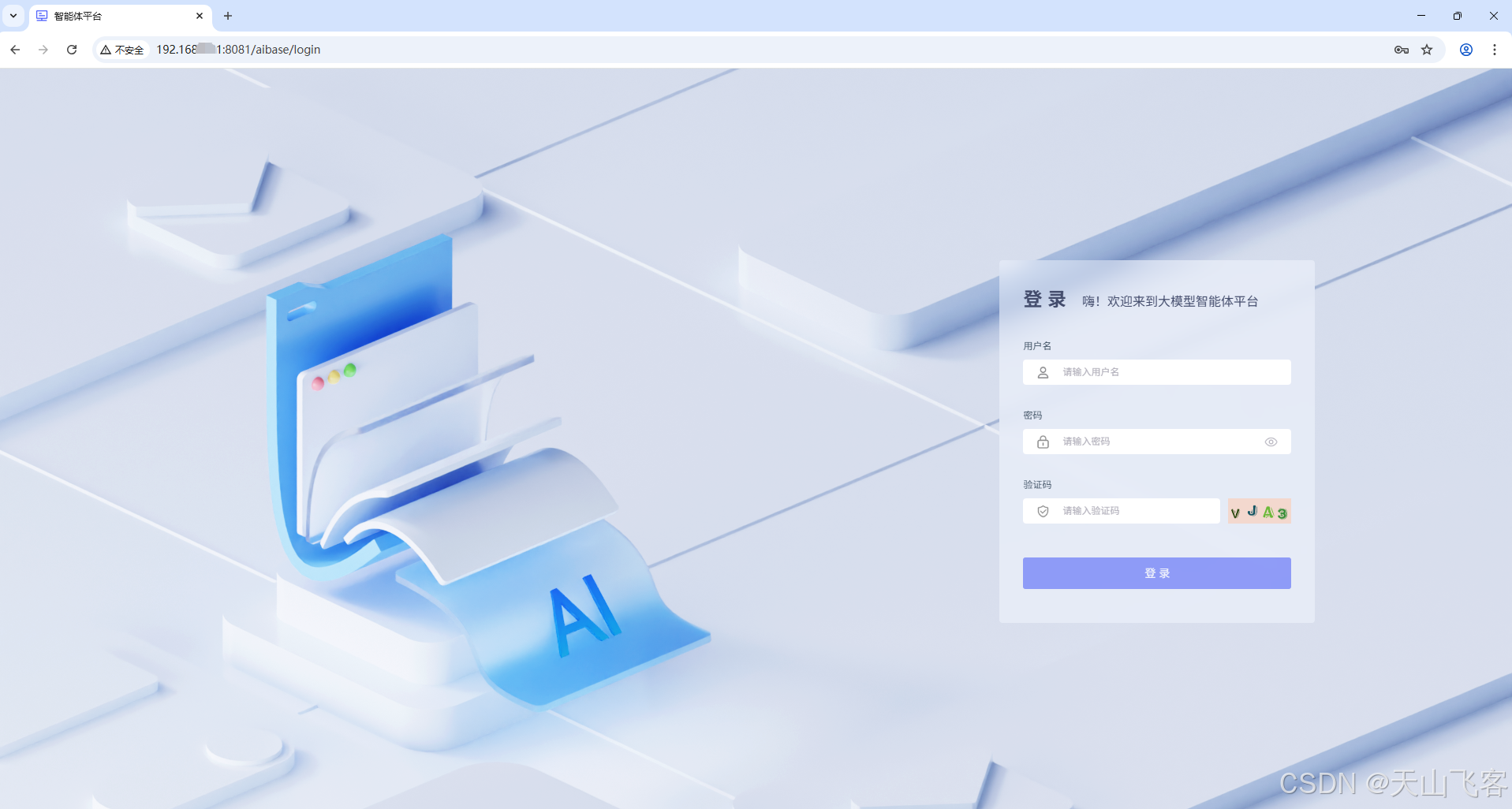

登录系统:http://localhost:8081

默认用户:admin 默认密码:Wanwu123456 -

关闭服务

# amd64系统执行: docker compose --env-file .env --env-file .env.image.amd64 down # arm64系统执行: docker compose --env-file .env --env-file .env.image.arm64 down

使用:

登录页,第一次登录会强制修改密码,安全细节不错!!!

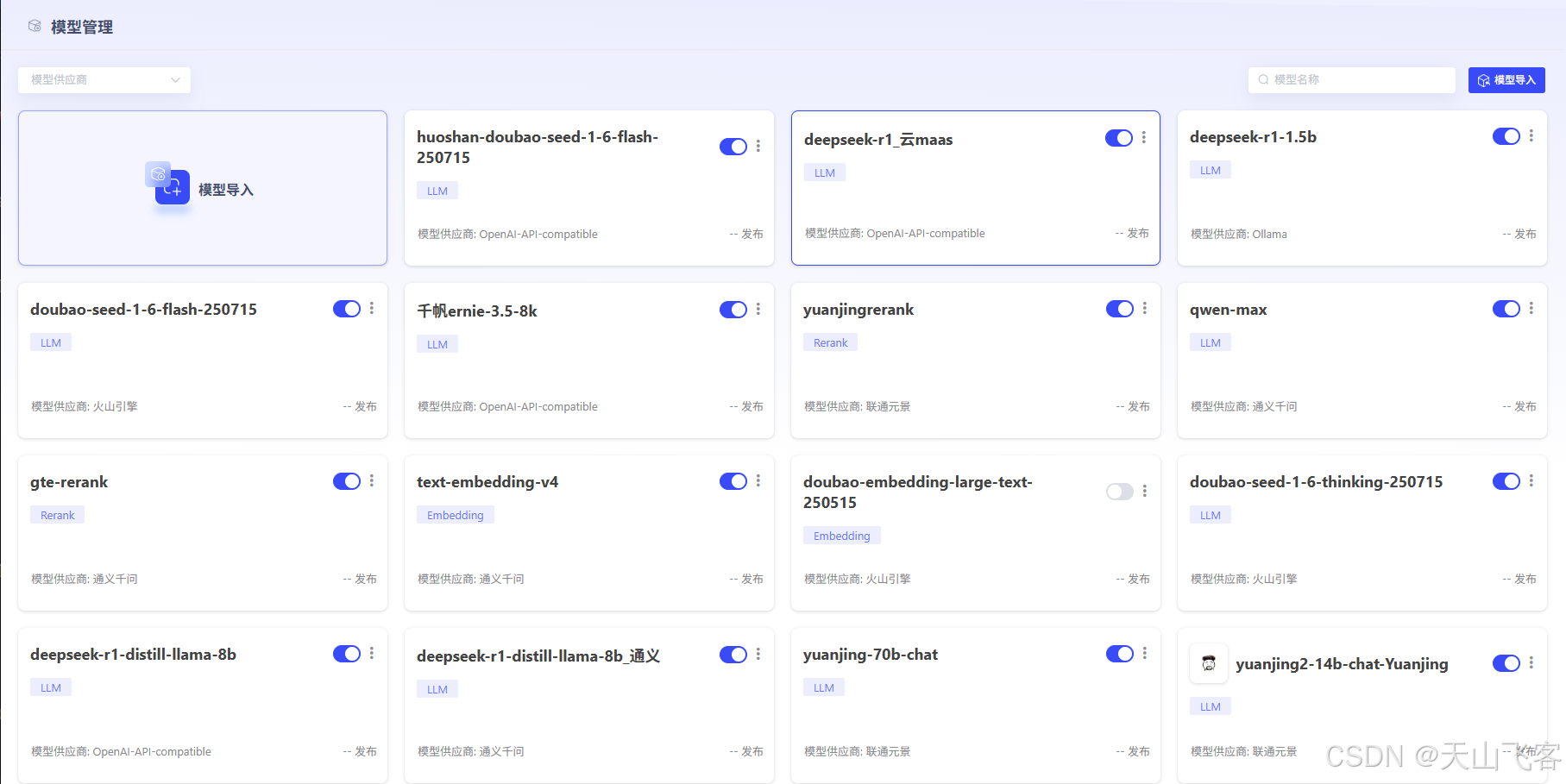

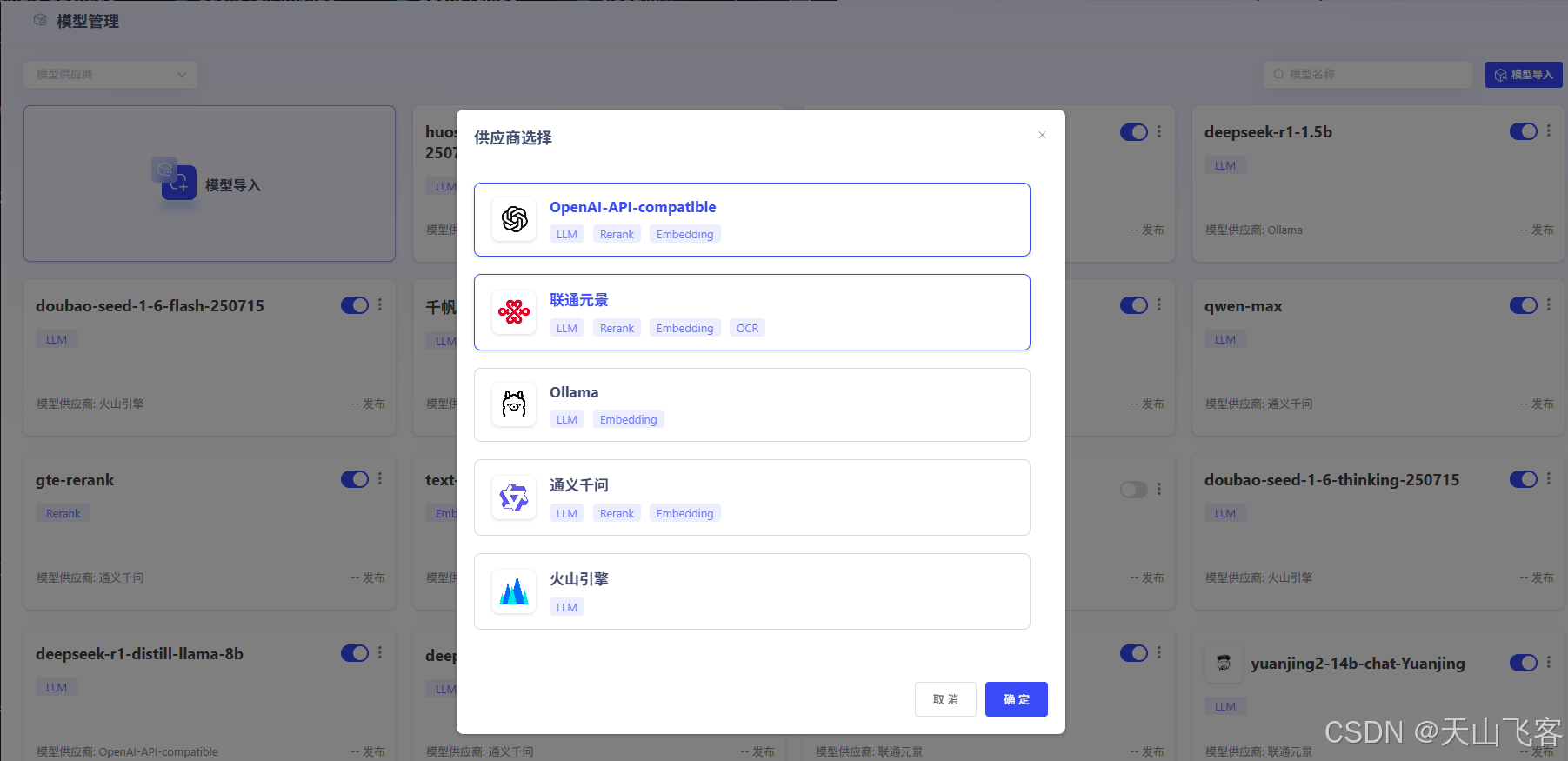

模型管理,可通过配置,在平台中接入外部模型。根据模型供应商规范,关联推理url。支持导入的模型包括LLM、Embedding和Rerank,开启服务后,可用于模型推理

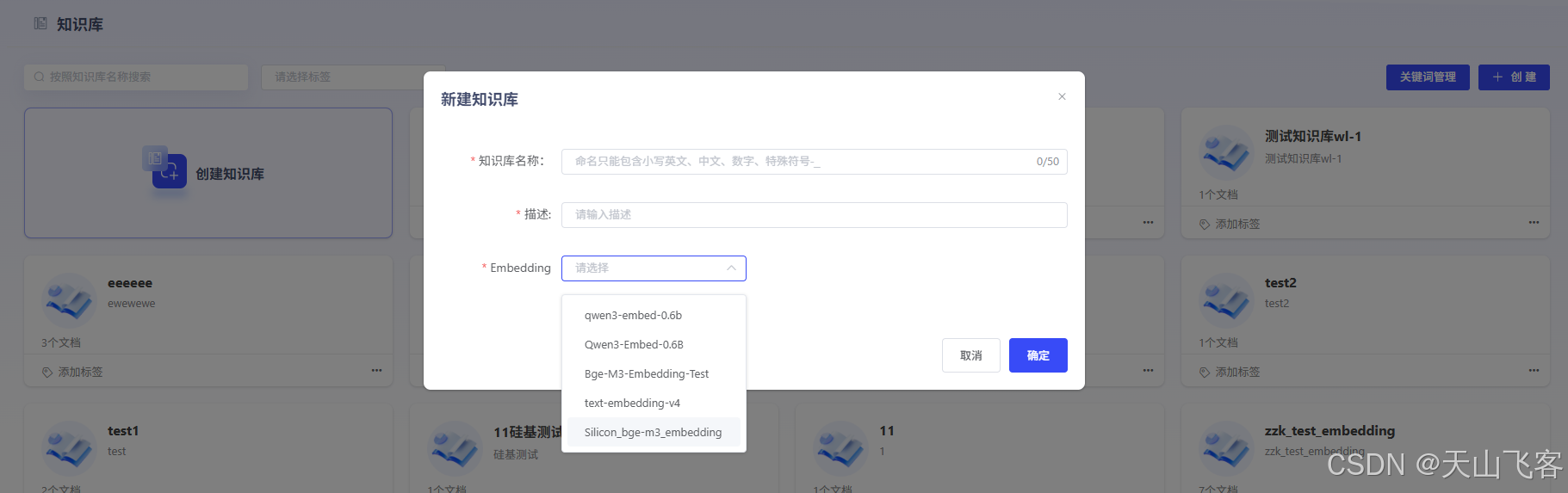

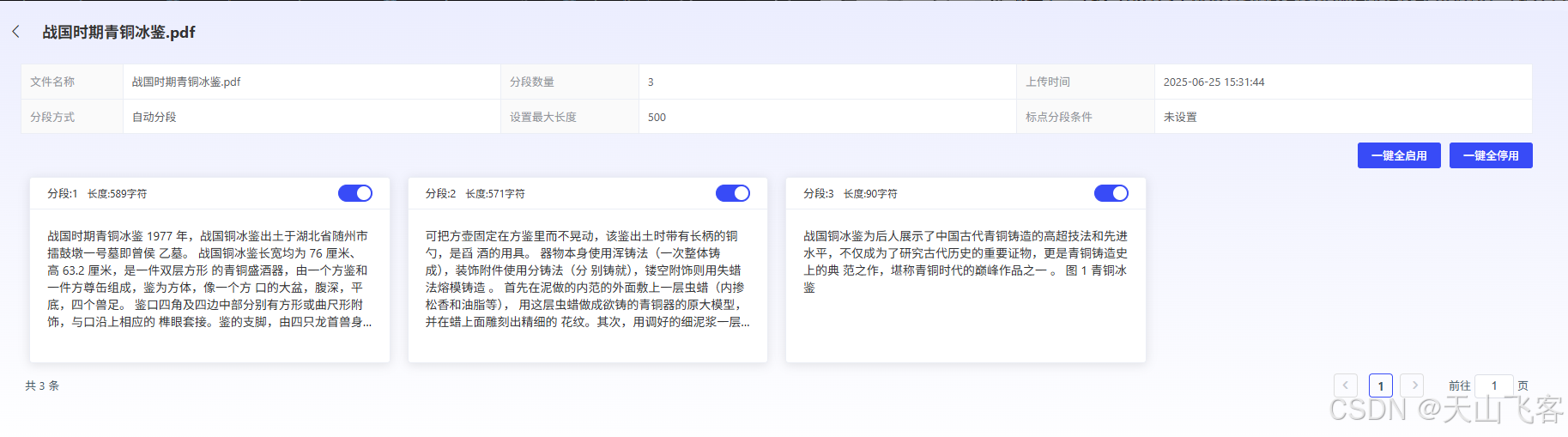

RAG知识库:

创建知识库时,可自定义选择要使用的Embedding模型。

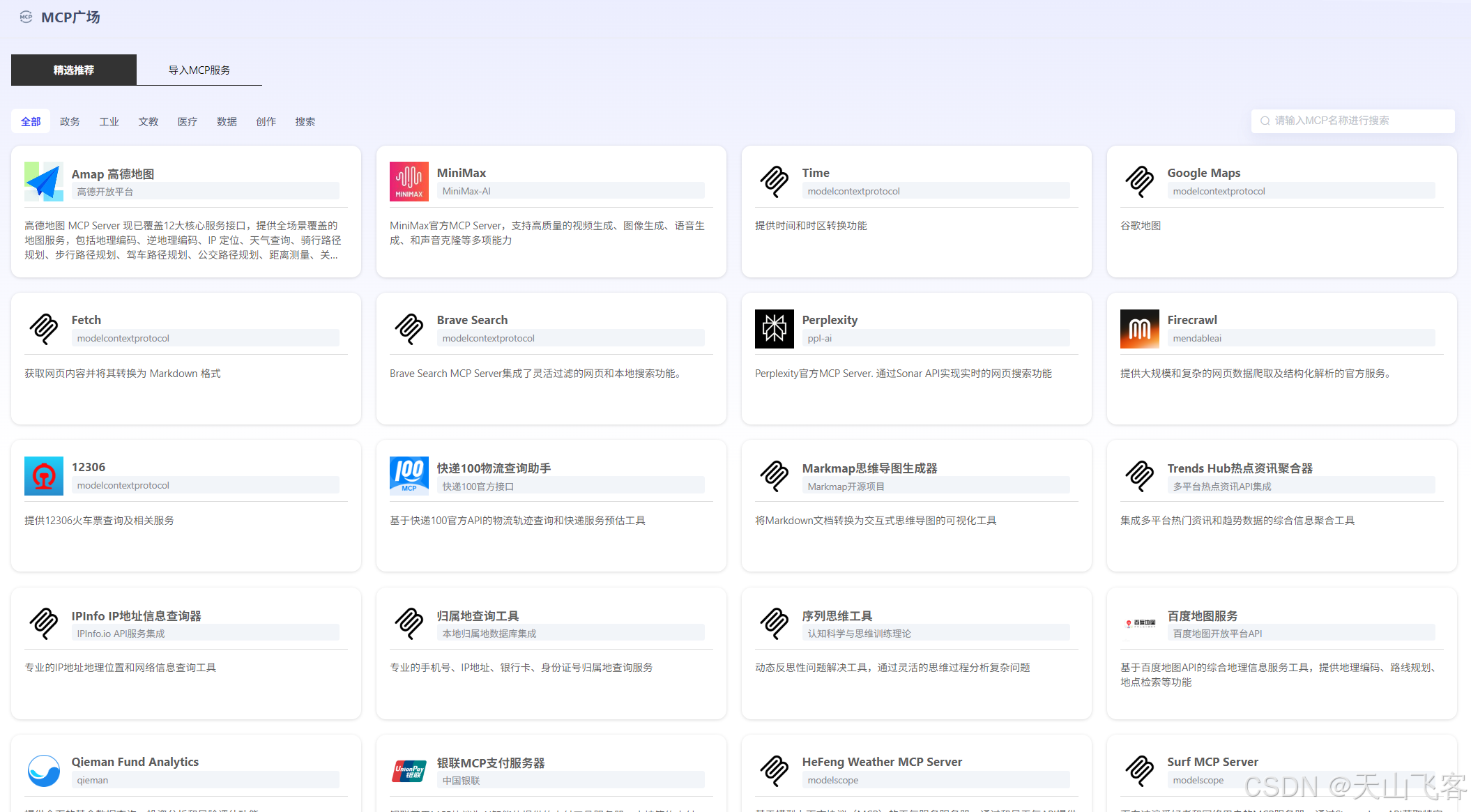

MCP:

内置了很多MCP Server,包括很多行业了,大概有100+个,非常方便

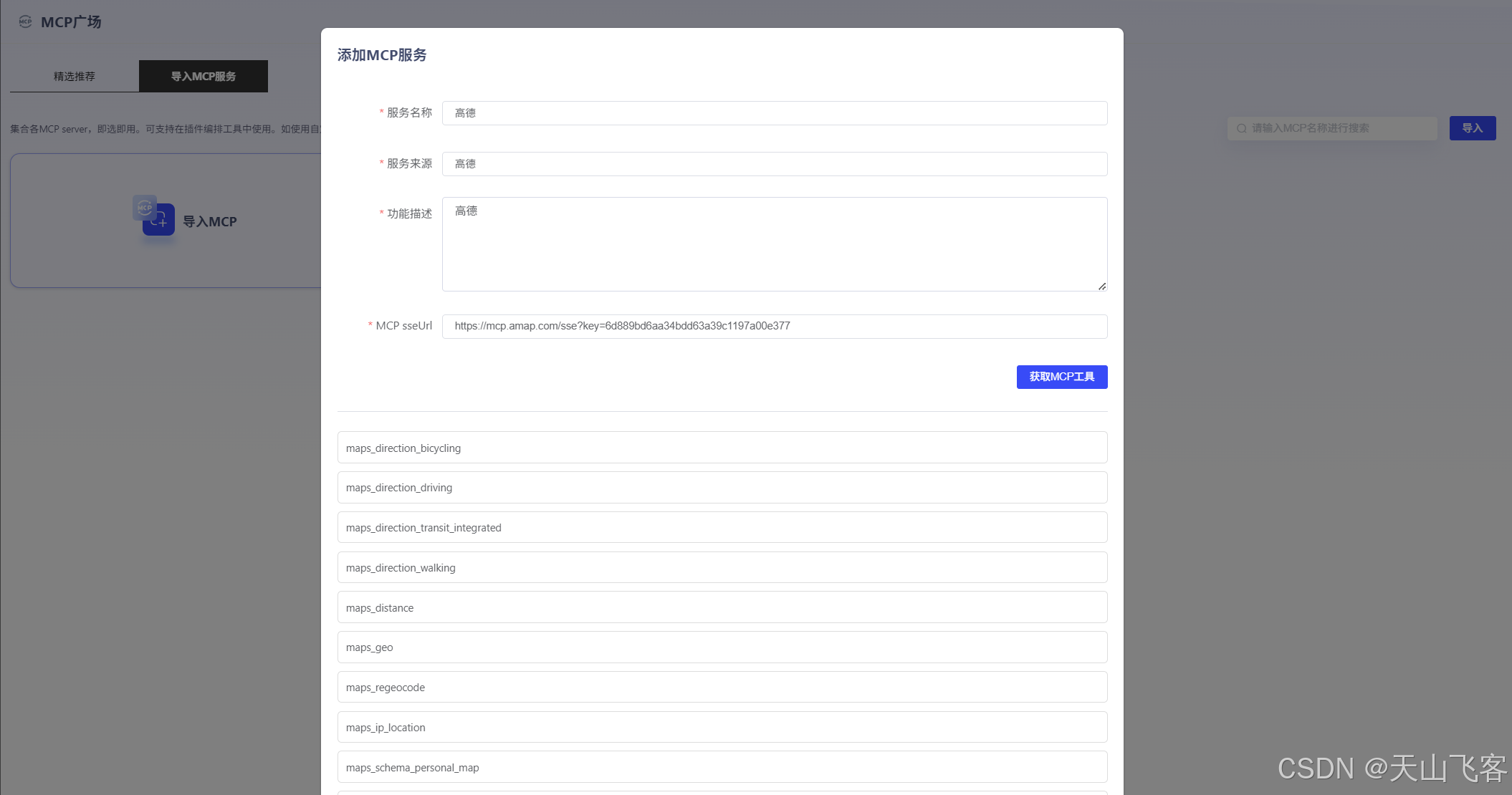

也可以自定义导入MCP Server,关联自己的MCP,填写好服务名称、服务来源、功能描述、MCP ServerURL。点击“获取MCP工具”,获取成功后,将显示可用接口。点击确认发布后,即可在工作流中使用。

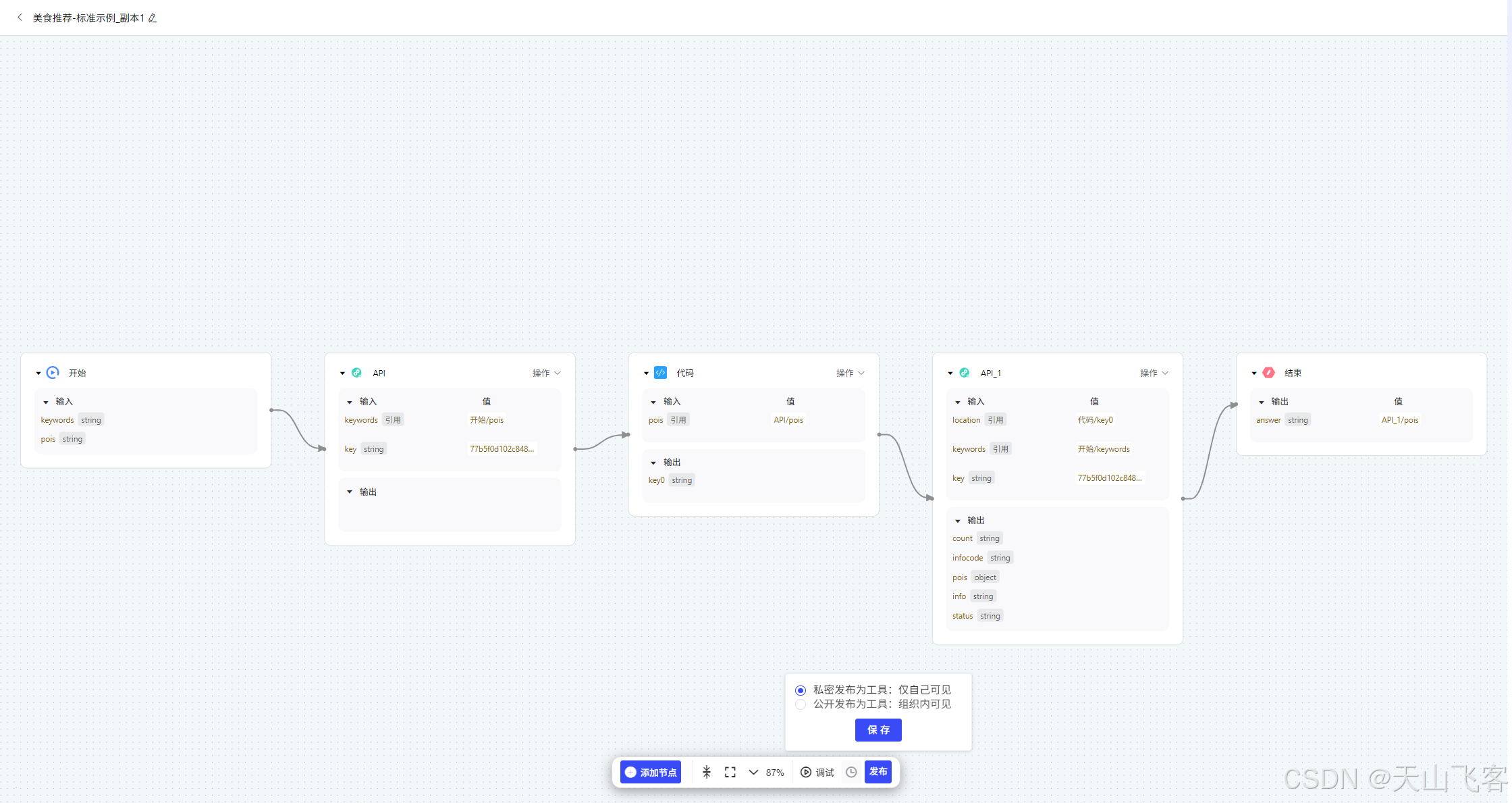

工作流:

拖拉拽方式自定义编排DAG(有向无环图)工作流任务

智能体:

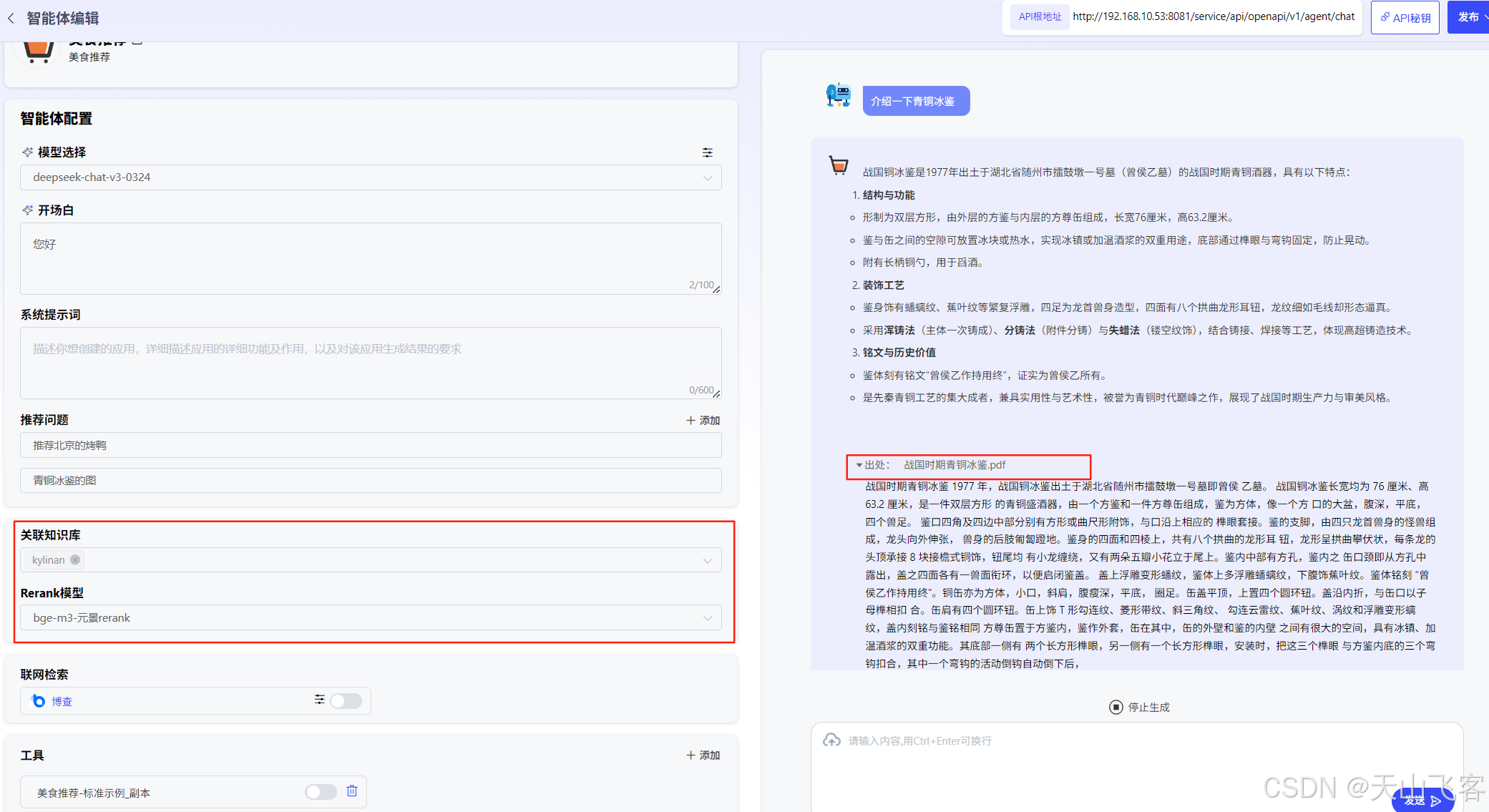

智能体作为平台的主要功能 ,编排可配置的选项也比较多,可以关联知识库及RAG用到的rerank模型,也可以配置联网搜索,工具那里可以配置发布好的工作流任务。

体验总结:

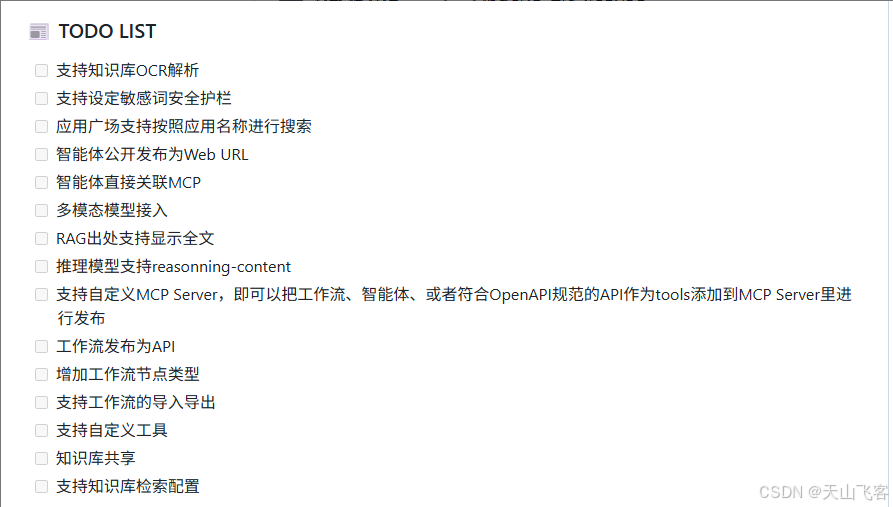

功能完备,License友好,专为企业级场景打造,具备高度自由度以满足行业深度定制需求。同时部署流程极其简单,能快速实现交付上线。此外,readme里还列了一些todo,都是一些比较实用的功能,github上更新比较频繁,每周都会发布一个版本,后续会持续跟进其功能的迭代。

|SVM-拉格朗日函数求解中-KKT条件理解)

)

—模板方法模式)